最高の瞬間を見逃すことなく、お気に入りのプレーヤーに注目

Aaron Baughman、Stephen Hammer、Eythan Holladay、David Provan、Ryan Whitman

2019年4月9日公開

80名から90名のプレーヤーにより5,000ホール近くがプレーされるマスターズ・トーナメント。約20,000ショットが記録・収集され、世界に配信する動画制作に活用されます。たいていの場合、観客は放送局が制作・配信する動画チャンネルでしかショットを見ることができません。しかしこれではお気に入りのプレーヤーやマスターズで起きるエキサイティングな瞬間が数多く見落とされてしまう可能性があります。

この問題を解決するために、IBM のAIシステムは動画に収められた各ショットに、平等で公平な興奮度スコアを割り当てます。これらのショットの動画は、興奮度スコアに応じてランク付けされた後、各プレーヤーのハイライト動画「Round in Three Minutes(3分間のラウンドハイライト)」の候補となります。

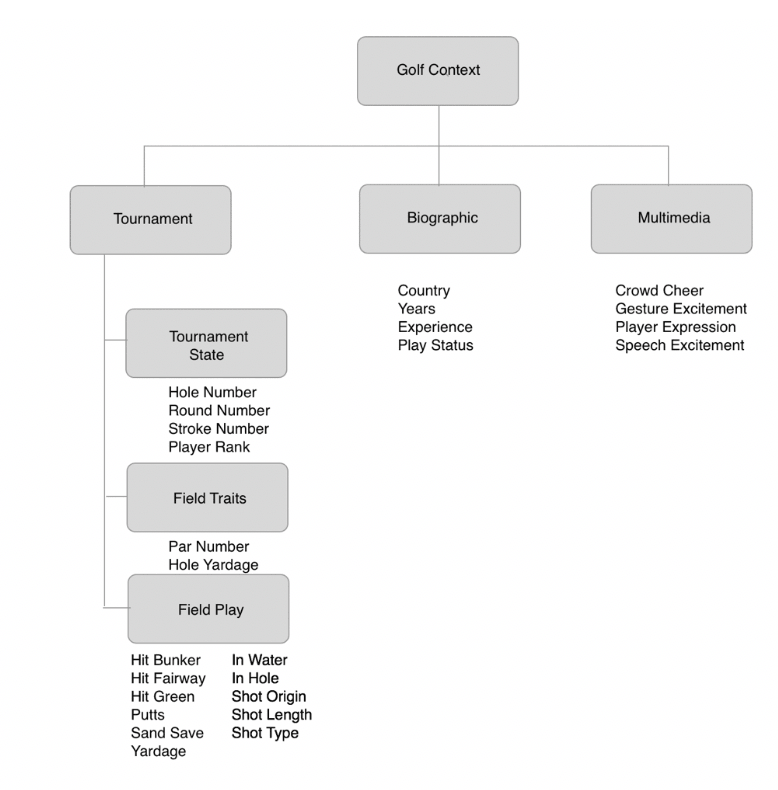

アジャイルなAIアーキテクチャーは、ディープ・ラーニング技術を活用して、各動画クリップ内の音声、ビジュアル・コンテンツ、モーションの興奮度を測定します。マルチメディア興奮度シグニチャーは、ボールの位置、ショットの距離、ホールのヤード数など34の状況項目に基づき、総合的な興奮度スコアを示します。このソリューションでは、公平かつ正確な総合的な興奮度レベルの測定を実現するために、意図的ではないバイアスをモニターしています。これにより世界中のパトロンは、自動生成されたお気に入りのプレーヤーのハイライト動画をトーナメント中に見る機会を得られるのです。

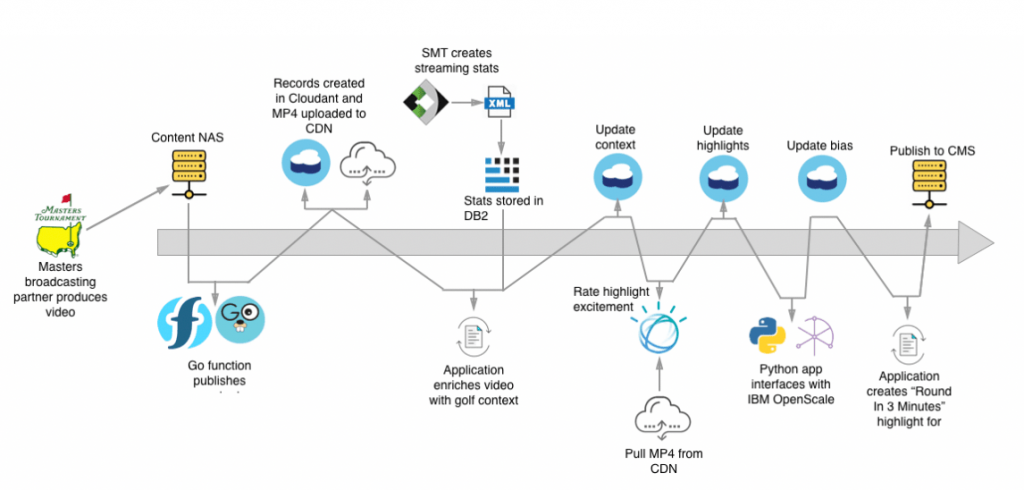

未加工の動画を3分間のハイライト動画にするデータ・フローは、IBM Cloudant上に構築されたワークフロー・パターンに基づきます。まずテレビ放送局であるCBSが、マスターズ・トーナメントの全ショットの動画を収集して、NAS(Network Attached Storage)デバイスにアップロードします。

続いてGo機能がMP4形式とMPX形式の新規ファイルの有無を確認するためにストレージ共有をモニターします。Go機能は、コンテンツをNASデバイスからコンテンツ配信ネットワーク(CDN)にアップロードすると同時に、Cloudant上で動画へのポインター・レコードを作成します。

上記ステップで作成されたCloudantレコードは、Cloudantの更新管理機能によって、追加のデータで3回補強されます。各ステップではCloudantビューを使用して、レコードを処理キュー(待ち行列)に配置します。そしてこのキューからレコードが選び出され、メタデータで補強されます。

最初のステップで、レコードはDB2 on Cloudデータベースから引き出されたゴルフ、経歴、統計に関する34の項目で補強されます。補強されたレコードは、ハイライト動画の作成にむけたランク付けのため、Cloudant内の「感情のキュー」に入れられます。次のステップとして、各場面の興奮度をランク付けするシステムが、Cloudantの感情のキューから新規の行を抽出し、AIを使用してコンポーネント・レベルでハイライト指標を作成します。その後更新管理機能がハイライトの結果をCloudantレコードに書き戻して、バイアス処理のキューに入れます。Pythonで開発されたPoC (概念検証)システムは、すべての新規レコードを抽出して、Watson Machine Learningによって総合的なコンテキスト・ハイライト・スコア付を行います。このプロセスでは、IBM Watson OpenScaleが、ホール数や観衆の声援の興奮度など、選択された属性に基づいてスコアを学習し、バイアスを緩和します。これらのコンテキストとバイアス緩和済みのコンテキスト・ハイライト・スコアもCloudantに保管されます。

プレーヤーのラウンドが終了すると、スクリプトが最もエキサイティングなショットを集約して、3分間のハイライト動画を作成します。この動画はビジネス・ルール、動画クリエイティブ、テレビ・グラフィックス、ブランディング要件を考慮に入れて作成されます。完成したハイライト動画は、世界中への配信にむけてコンテンツ管理システム(CMS)にアップロードされます。

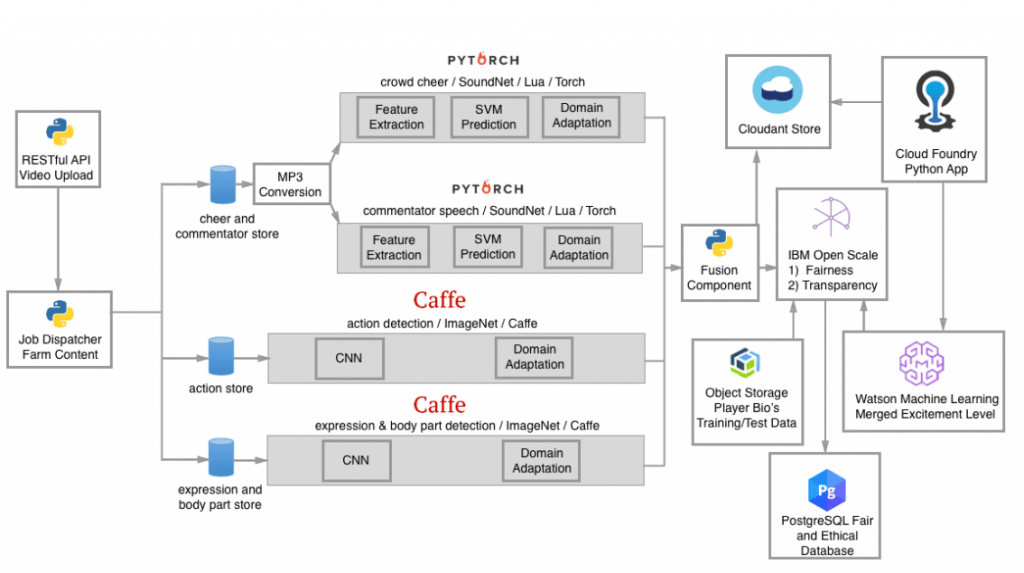

AIハイライト・システムは、複数のディープ・ラーニングと機械学習の技術を使用して、動画の興奮度を判定します。各動画は動画と音声の要素に分割されます。音声要素はMP3形式に変換され、ディスク・ストアに配置されます。Pythonプロセスは、そのMP3ファイルを選び出し、PyTorchライブラリーを備えたSoundNetというCNN(畳み込みニューラル・ネットワーク)にコンテンツを送信します。音声の空間表現を取得するために、CNNの最終層は削除されます。ゴルフについて学習したサポート・ベクトル・マシン(SVM)に、このベクトルが入力されます。2つのSVMを適用して、観衆の声援と解説者の音声の興奮度のスコアが生成されます。マスターズの前年からの動画音声の変化を補うために、スコアはさらにスケーリングされます。

動画要素は視覚的側面から分析されます。各画像は、ImageNetで学習済みのCaffeフレームワーク内のVGG-16モデルに送信されます。VGG-16はエキサイティングなゴルフのジェスチャーを認識するように適合されています。ゴルファーの興奮度をスコア付けするために、アクション興奮度スコアがスケーリングされます。同じ一連の画像を用いて、ゴルファーの顔の表情や身体の動きをを判別します。頭や胴体などの身体の動きを追うことで、動作の速度が判別されます。そして抽出された身体部分の動きと顔の表情の組み合わせにより、被写体の全体的な興奮度レベルを判定します。

声援、動作、身体、顔の表情の分析から得られた個々のスコアは、総合的なマルチメディア興奮度スコアに集約されます。それぞれの興奮度スコアは、後続処理のためにCloudantデータ・ストアに保存されます。

IBM Cloud上にCloud Foundryアプリケーションとして配備された別のPythonアプリケーションがCloudantをポーリングしてレコードを取得し、意図的ではないバイアスを削除して興奮度をより公平はものに調整します。Watson OpenScaleの複数のAIなテクノロジーが公平性を検出し、緩和技術によって総合的なコンテキスト興奮度を修正しながら、モデルの精度をモニターします。バイアスを測定して削除するために、34の状況項目とマルチメディア・スコアを統合します。例えば、知名度の低いプレーヤーよりも有名プレーヤーの方に観衆が多く集まる傾向があるため、声援の音声の興奮度にバイアスが含まれることがあります。その結果、声援が大きい有名プレーヤーの方が、知名度の低いプレーヤーよりもエキサイティングなショットを打ったと判定してしまいます。Pythonアプリケーションは、Watson Machine Learningに配備された学習済みのSVMを呼び出すことにより、総合的なコンテキスト興奮度スコアを提供します。各スコアリング・ペイロードは、バイアスと精度の継続的な測定のためにWatson OpenScaleに送信されます。Watson OpenScaleは、一連のモニタリング属性のスコアからバイアスを取り除くためのバイアス緩和モデルを学習します。

ゴルフの状況属性のオントロジーは、総合的な状況スコアとバイアス緩和済み状況スコアの両方につながる保護属性を列挙するように定義されています。マスターズの開催期間中、分析対象動画でショットを打っているプレーヤーのホール数、プレーヤーのランク、ストローク数などのトーナメントの状況から、興奮度の予測の判断材料を得られます。パー数やホールの距離など、各ホールに関する詳細情報が状況興奮度スコアに組み込まれます。フェアウェイキープ率、池ポチャ、サンドセーブ率など、ショットの結果をまとめた追加の属性により、プレーヤーの成績指標を得られます。

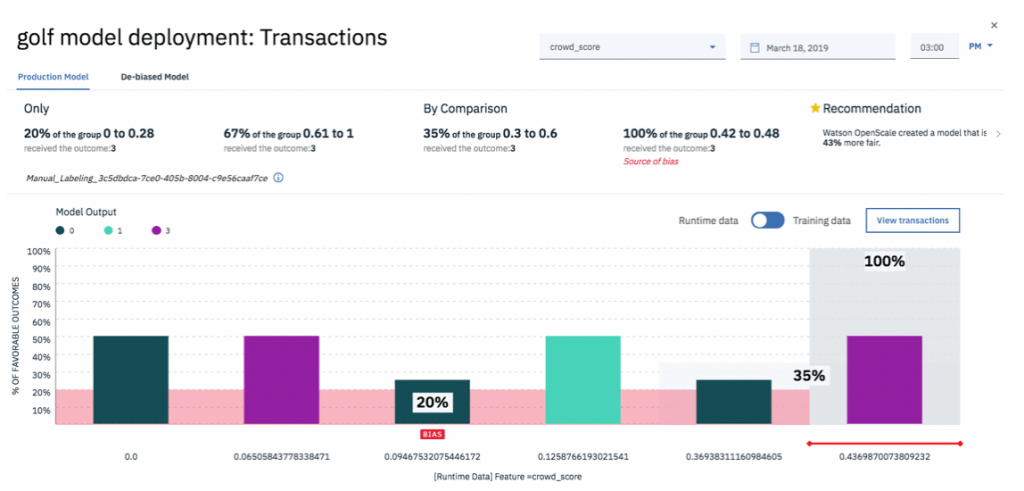

トーナメント期間中、Watson OpenScaleは、声援の興奮度スコアとホール数の2つの属性に基づいて状況スコアのバイアスをモニターします。ハイライト動画の生成に際しては、観衆が多いプレーヤーと少ないプレーヤー、そしてアーメン・コーナーと16番と18番のホールとその他のホールであるかを勘案する必要があります。Watson Machine Learningは、興奮度が最も低い0から最も高い4までの総合的な状況興奮度スコアを付けます。観衆のスコアの参照グループとして[0.3,0.6]が選択されます。0は観衆のノイズがなく、1は最も大きいことを意味します。私たちは、モニタリング対象グループの[0,0.29]と[0.61,1]には、観衆の人数においてバイアスが含まれるであろうと考えました。このようにしてWatson OpenScaleによって検出されたバイアスによって、総合的な状況スコアが調整されるため、バイアスが減少します。次の画像では、新たな事後調整モデルによって総合的な観衆のノイズのバイアスが43%減少します。

一般に、マスターズで最も人気のあるホールは、アーメン・コーナー(11番ホール、12番ホール、13番ホール)、16番ホール、18番ホールです。私たちは、これ以外のホールのショットの興奮度が公平に判定されるようにする必要がありました。そのため、Watson OpenScaleは、ホール数に基づいて異なる影響スコアを改善するための事後調整モデルを作成しました。若干調整されたバイアス緩和済みスコアによって精度が低くなることはありません。

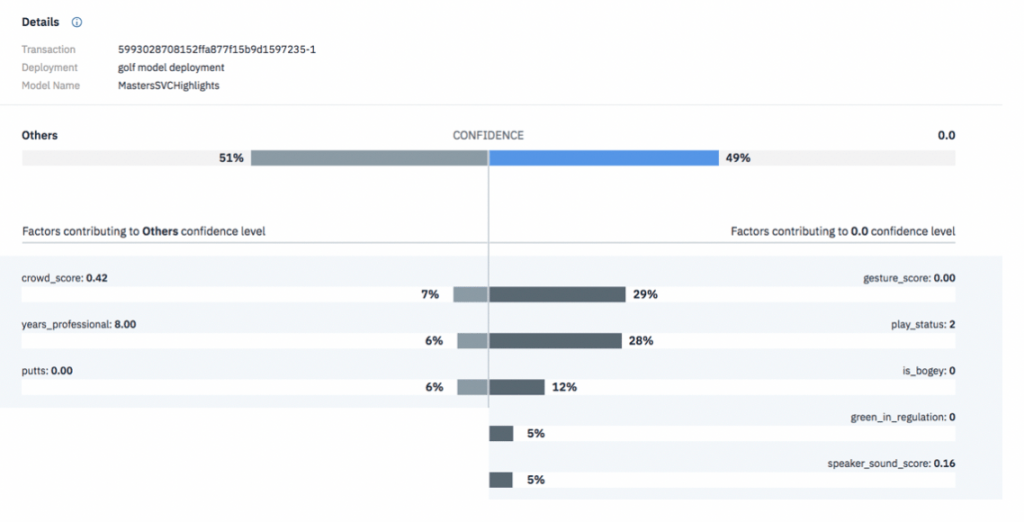

各場面の興奮度がランク付けされた後、私たちは属性のコントリビューションの透明性によって「なぜ?」という質問に答えることができます。ハイライトの興奮度のランキングが低い場合、アルゴリズムの決定を支持もしくは否定した要素を判別できます。次の画像では、ジェスチャーとスピーカーの音声のスコアの低さが低ランキングの原因であることが分かります。ボギーを外したり、グリーンに乗らなかったショットは、興奮度にマイナスの影響を与えています。しかし平均的な観衆のノイズと、プロゴルファーとしての長い経験年数は、興奮度をより高めています。このショットは、他の要因のコンテキストにおいてパッティングではなかったため、アルゴリズムには、興奮度スコアをより高くする根拠があります。

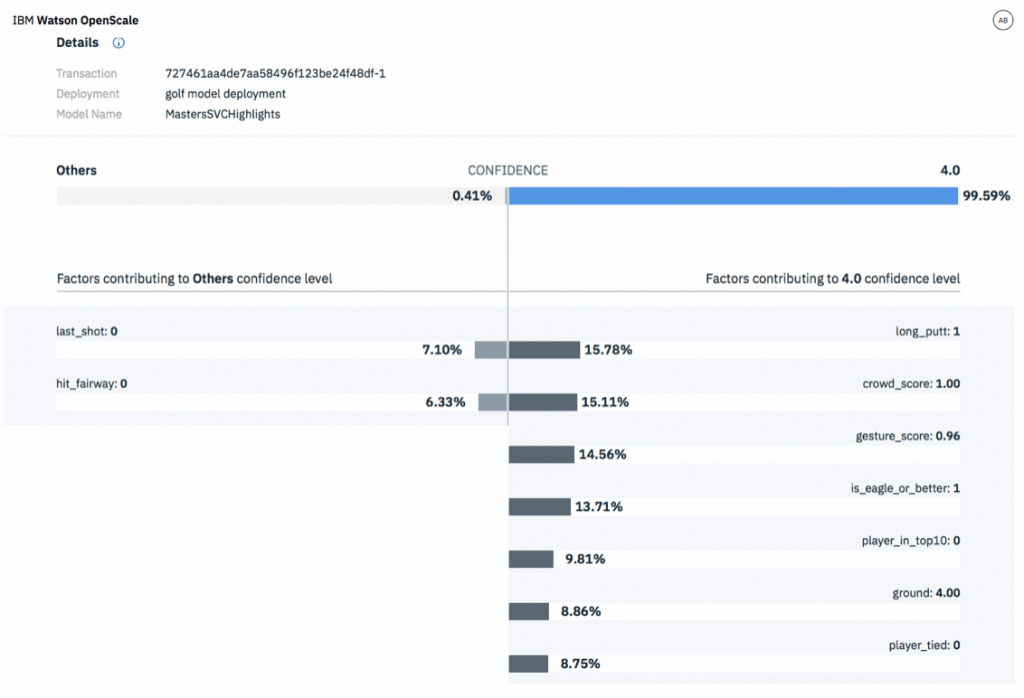

もう1つの例では、IBM OpenScaleの最高興奮度スコア4.0の確信度は99.49%でした。スコア4.0であるとする確信度の主な原因は、ショットがグリーン上でのロング・パットであったことでした。次に確信度の高い2つの予測判断材料は、1.0のうち、1.0の観衆スコアと0.96のジェスチャー・スコアでした。

最も注目すべきは、ゴルファーがイーグル以上のスコアでホールアウトしたショットであったことです。このショットがホールの最後のショットではなく、フェアウェイから打たれたものでもなかったことから、スコア4.0に対する確信度が得られました。

各ハイライトは、クエリー条件とフィルターに基づいて取得することができます。特定のホールでの特定のプレーヤーに関する最高のスコアリングのハイライトをレビューすることができます。私たちは一歩先まで踏み込み、Python Image Library (PIL)とリアルタイム・スコアリング・データでPythonスクリプトを使用して、放送品質グラフィックスを生成します。AIが選択した動画クリップは、MLTマルチメディア・フレームワークを使用して、放送グラフィックス、事前にレンダリングされたプレーヤーの紹介、タイトル・カードを組み込んで合成されます。ハイライト・動画がCDNにアップロードされた後、CMSシステムに通知されます。このようにして素晴らしい瞬間を世界中に配信することができるのです。

AIによって編集されたハイライト動画と「Round in Three Minutes」は、トーナメント全体を分析し、マスターズ・トーナメントのストーリーを語ります。これからは、最高の瞬間を見逃すことなく、お気に入りのプレーヤーを追いかけることができるのです。

※本ブログは The Masters exceptional AI highlights: A round in three minutes( https://developer.ibm.com/blogs/the-masters-exceptional-ai-highlights-a-round-in-three-minutes/ )の翻訳版です。