バリアフリーな社会インフラへの提案 ── 誰もが少しでも快適に街歩きを楽しめるような社会へ

目の不自由な人も、車いすの利用者も、訪日外国人も、一般買い物客も、誰もが少しでも快適に街歩きを楽しめるようにしたい ―― そんなバリアフリー・ストレスフリー *1 の街づくりを目指して、日本IBM東京基礎研究所と清水建設株式会社は、屋内外を区別なく案内する画期的な高精度音声ナビゲーション・システムを開発した。2017年2月には、両社は三井不動産株式会社と協力して、東京・日本橋の「コレド室町1~3」および隣接する日本橋室町地下街で実証実験を行った。今後も、さらに訪日外国人が増える中、誰もが少しでも快適に街歩きを楽しめる街づくりへの取り組みが注目されている。

スマートフォン利用者の属性に応じて、地図と音声で案内

この音声ナビゲーション・システムは、ビーコンと呼ばれるBluetoothの電波を発信する端末を設置した環境で、高精度な屋内外音声ナビゲーション・システムとコグニティブ技術を活用し、そこに訪れる人の属性に適した誘導方法により目的地まで快適に案内するための総合的なシステムだ。このシステムにアクセスするには、利用者はまずスマートフォンに専用アプリ「NavCog *2」をインストールする。次に、自分が視覚障がい者か、車いす利用者か、一般歩行者かを選択。するとスマートフォンは地図と音声で、一般歩行者には最短コースを、車いす利用者には階段や段差のないルートを、視覚障がい者には歩行速度に合わせたよりきめ細かいルート案内をしてくれる。個々の利用者の属性に応じ、障がいの有無に関わりなく、誰もが街歩きを楽しめるよう工夫されている。ここには、日本IBMが開発したコグニティブ・アシスタント技術(失われたり弱ったりした人の機能を補完、増強し、人々の活躍の幅を広げることを支援する技術)が使われている。

目の不自由な人向けに“ターン・バイ・ターン”方式を実現

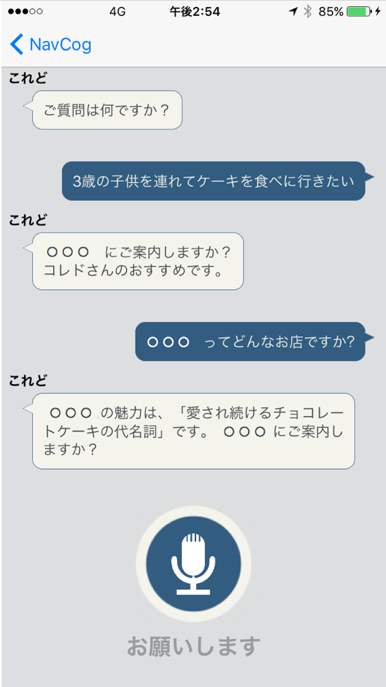

実際に、日本橋室町エリアで使われた実証実験システムの利用の様子を紹介しよう。利用者は自分が行きたい場所や意図をスマートフォンに話しかける。すると、エリア内にある約100軒のテナントやトイレ等の施設情報から、希望に合う目的地を推薦してくれる。たとえば、このような感じのやり取りになる。

利用者 「3歳の子どもを連れてケーキを食べに行きたい」

スマホ 「○○○にご案内しますか? コレドさんのおすすめです」

利用者 「○○○ってどんなお店ですか?」

スマホ 「○○○の魅力は『愛され続けるチョコレートケーキの代名詞』です。○○○にご案内しますか?」

利用者 「お願いします」

目的地が決まれば、コレド室町のフロアマップや施設情報をもとに、目的地までのルートがスマートフォン画面上の地図に示される。また、音声でのきめ細かい案内もスマートフォンを介して行われる。

視覚障がい者向けには、道を間違えてもきちんと誘導してくれるターン・バイ・ターン方式(分岐にさしかかったときに目的地へ向かう方の道を音声で示すカーナビ等で標準的な方法)のナビゲーションを屋内で初めて実現した。進行方向などを個々人の属性に合わせて、適切・的確な場所で、タイムリーに音声で指示するため、目的地までの経路を容易に認識することができる。また、耳をふさがず周囲の音も聞きたいという人は、骨伝導ヘッドフォンをスマートフォンにつなげて音声を聞きながら周囲の音にも気を配ることもできる。

ターン・バイ・ターン方式での音声案内の例:

利用者 「○○○に行きたいです」

スマホ 「9メートル進み、正面のエレベーターを使って3階に上がる」「出口に向かって右に操作ボタン。点字あり」「そろそろです」「後ろを向く、道を間違えたようです」「到着しました」

実際に視覚障がい者が使用している音声ナビゲーションのスピードは、晴眼者にとってはかなり速く感じられるが、聴覚が研ぎ澄まされれている視覚障がい者にとっては日ごろ聞き慣れているスピードでナビゲーションを使うことができる。

各業界のデジタル変革事例や経営者のインタビューなど、『THINK Business』の最新記事をピックアップし、毎月のニュースレターでお知らせいたします。

機械学習により快適さを実現する誤差水準を追求

今回の実証実験は、2万1000平方メートルの広さの空間で行われた。200個程度のビーコンを天井裏など目立たない場所に5~10メートルの間隔で設置し、利用者の位置の推定平均誤差が1から2メートル程度という世界最高レベルの高精度を実現した。

高精度の理由はもう1つある。実証実験スタート前の数日間、高精度のセンサーを搭載した車いすを縦横に走らせ、ビーコン電波の強弱をきめ細かく測定。そのデータをコンピューターが機械学習して高精度な屋内測位のモデルを作り上げた。ビーコンとスマートフォン内蔵の加速度計、気圧計、ジャイロスコープの情報を連動させることで正確な位置推定が可能になったのだ。

会話で活躍するWatsonの対話型インターフェース

利用者とスマートフォンの会話で、なぜこれほどスムーズに意思疎通ができるのだろうか。それは、会話の裏側で先ほどの利用者が質問した「3歳の子どもを連れて」という言葉から、「3歳児を連れて入れる店」という意図を、この音声ナビゲーション・システムがしっかりくみ取り、子ども連れに配慮したカフェレストランを選んでいる点だ。こうした微妙な言い回しにも対応しているのは、Watson Assistantを活用してIBMクラウド上に構築した対話型インターフェースだ。

今回の実証実験の多くの参加者から、この音声ナビゲーション・システムを評価し、また広く普及することを望むというコメントが寄せられたという。日本IBM東京基礎研究所の高木啓伸研究員は「今回の実証実験に参加いただいた皆様のご意見は大きな自信になりました。いずれはこのような対話型インターフェースをもつ、音声ナビゲーション・システムを世界に広めていきたい」と語る。

また、自身が全盲であり、視覚障がい者のアクセシビリティー改善のために長年研究してきた同研究所のIBMフェロー浅川智恵子は「視覚障がい者にとって嬉しいのは、一人で買い物を楽しんだりレストランを探したり、自由に街を楽しめることです。今回の実証実験では、私自身もナビゲーション技術で行動範囲が広くなることを実感できました。今回は国土交通省の『次世代ワイヤレスコリドー形成プロジェクト』として認めていただくことで大規模な実証が可能になりました。今後も様々なパートナーの方々のご協力の元でこの技術が成長し、日本中にそして世界中に広がっていけばと願っています」と、語った。

実証実験では、日本語と英語を対応言語とした。今後Watsonが対応する他の言語を活用する街が出てくれば、たとえば、食事、衣料品、お土産品など、各テナントの品揃えを多言語データにしてWatsonに学習させ、訪日観光客の日本での体験をより楽しいものとすることもできるようになるだろう。

近い将来、都市全体にこのようなシステムが拡充し、屋内も屋外もバリアフリー・ストレスフリーの街に変貌することは夢物語ではない。その実現を支援すべく、日本IBMは2015年秋から今回の実証実験に使用したシステムの基本技術をオープンソース・ソフトウェアとして公開し、精力的に開発を続けている。未来のバリアフリー・ストレスフリー社会は、こうした技術や様々な人々との協働の積み重ねから実現されていくと信じるIBMの研究活動はさらに加速する。

*1 国土交通省の提唱する概念で、訪日外国人や高齢者、障がいのある方々など、誰もが目的地へ円滑に移動できる社会を意味する。

*2 IBMおよびCarnegie Mellon University(CMU)などが共同で開発するオープンソース・プロジェクトHuman-Scale Localization Platformの成果に基づいてCMUが公開するアプリ。

各業界のデジタル変革事例や経営者のインタビューなど、『THINK Business』の最新記事をピックアップし、毎月のニュースレターでお知らせいたします。