地理的に分散した Db2 pureScale クラスター (GDPC)

地理的に分散した Db2 pureScale クラスター (GDPC) は、 Db2 pureScale クラスターを分散させ、異なるサイトにクラスターのメンバーを配置できるようにする構成です。

Db2 pureScale Feature は、 AIX® および Linux® プラットフォームでの優れたデータベース・スケーラビリティー、可用性、およびアプリケーション透過性を提供し、ゴールド標準である Db2 for z/OS® Parallel Sysplex ® のデータ共有アーキテクチャーを基礎としています。 ただし、 Db2 pureScale システムや Db2 for z/OS Parallel Sysplex であっても、単一サイト・システムは、大規模な電源障害や通信障害などのサイト全体を危険にさらす外部イベントに対して脆弱である可能性があります。

電源障害や火災などの災害により 1 箇所のデータ・センターが利用できなくなる可能性があるため、大規模な IT 組織の多くは、別々の電源網になるよう十分に距離をとって 2 つのサイトを構成します。 この構成により、全体が停止するリスクは最小限になり、片方のサイトが災害の影響を受けている場合でも、もう片方のサイトでビジネスを継続できます。 地理的に分散した Db2 pureScale クラスター (GDPC) は、 Db2 for z/OSの Geographically Dispersed Parallel Sysplex 構成と同様に、通常の単一サイトの Db2 pureScale クラスターのスケーラビリティーとアプリケーション透過性を提供しますが、「アクティブ/アクティブ」なシステム可用性を実現するクロスサイト構成です。 多くの種類の災害にも直面しています

アクティブ/アクティブは重要です。これは、通常の操作中に、両方のサイトの Db2 pureScale メンバーが通常どおりにワークロードを共有し、ワークロード・バランシング (WLB) により、サイト内およびサイト間の両方のすべてのメンバーで最適なレベルのアクティビティーが維持されることを意味します。 これは、2 つ目のサイトが、何らかの問題が発生するのを待機しているスタンバイ・サイトではないことを意味しています。 その代わりに、2 つ目のサイトは、日常の運用においても投資に対して価値を返し、それ自体の役割を果たしています。

GDPC の概念

- 2 つ以上の Db2 pureScale メンバー

- 2 つのクラスター・キャッシング・ファシリティー (CF)

- IBM® Spectrum Scale を実行する SAN 接続のクラスター・ストレージ注: 現在、GDPC でサポートされているレプリケーション・テクノロジーは、 IBM Spectrum Scaleのみです。

- Db2 メンバーとクラスター・キャッシング・ファシリティーとの間の通信用の専用ネットワーク。 これには、InfiniBand (IB) や Remote Direct Memory Access (RDMA) over Converged Ethernet (RoCE) の高速相互接続を使用できます。 代わりに TCP/IP over an Ethernet ネットワークにすることもできます (Db2 Cancun Release 10.5.0.4 以降でサポートされている RDMA と特殊な RDMA ケーブル・アダプターを使用する必要はありません)。

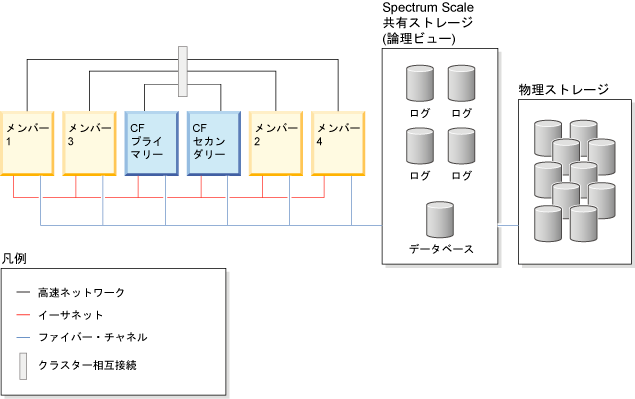

図 1 は、4 つのメンバーと 2 つの CF を持つ標準的な Db2 pureScale クラスター構成を示しています。 Db2 pureScale Feature は、共有データ・アーキテクチャーです。このアーキテクチャーでは、すべてのメンバーがデータベースの単一コピー上で動作し、CF を介して相互に通信してアクティビティーを同期し、アプリケーションの要求に応じてデータの取り込み、変更、および取得を行います。 メンバーと CF との間のメッセージは、クラスター相互接続を介して RDMA 機能を使用します。これによって、通信の待ち時間が極めて短くなり、メッセージごとの CPU 使用率も非常に低くなります。 イーサネット・ネットワークを使用する Db2 pureScale クラスターでは、非常に限定されたメンバー間通信がいくつかあります。

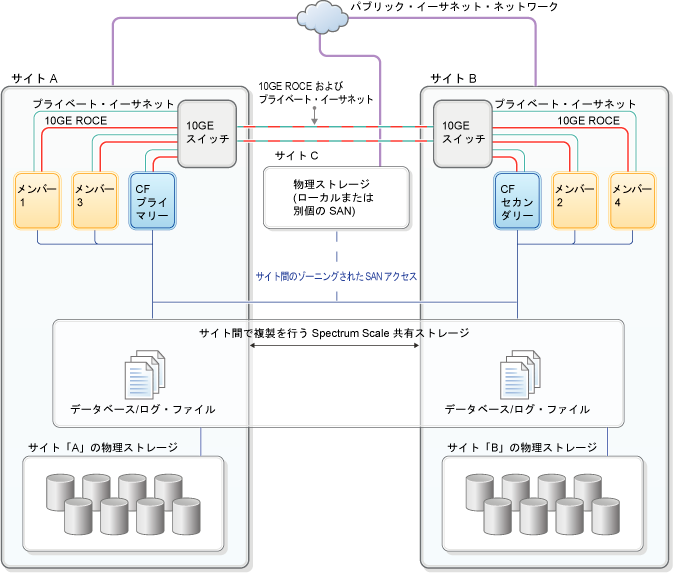

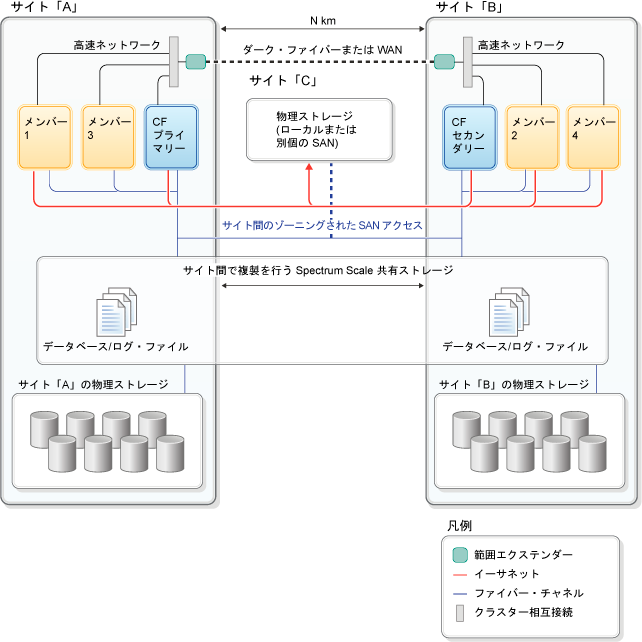

Db2 pureScale クラスターを 2 つのサイト間で半分に分割することは、メンバー・システムの半分が物理的にサイト A に配置され、半分がサイト B に配置されることを意味します。 サイト障害が発生した場合に均等で透過性のあるフェイルオーバーを行うには、3 番目のサイトが必要です。 Single Point of Failure (SPOF) を防ぐために、2 つのメイン・サイトのそれぞれに 1 つの CF を配置する必要があります。 最高のパフォーマンスとスケーラビリティーを維持するために、RDMA 対応のサイト間相互接続を使用して、一方のサイトのメンバーから他方のサイトの CF へのメッセージができる限り速く低コストで届くようにします。 InfiniBand ネットワークの距離は、通常数 10 メートル、場合によっては数 100 メートル単位で測りますが、Obsidian Longbow InfiniBand エクステンダーのような装置を使用して、広域ネットワークまたは専用光ファイバー・リンク上で高速相互接続ネットワークの距離をもっと広くとることができます。

メンバーや CF などのコンピューティング・リソースの分散に加えて、災害時リカバリー (DR) クラスター構成でも、サイト間でのストレージの複製が必要です。 標準の Db2 pureScale クラスター設計に基づいて構築された GDPC 構成では、サイト間で IBM Spectrum Scale 同期レプリケーションを使用して、クラスター全体ですべてのディスク書き込みアクティビティーを最新の状態に保ちます。 これには、表スペース書き込みとトランザクション・ログ書き込みの両方が含まれます。

大まかに、GDPC クラスターはネットワークの種類に応じて以下のいずれかの図のようになります。

RoCE ネットワーク上の GDPC (AIX および Linux)

他のオプションも存在しますが、要求が厳しいワークロードを処理する実動クラスターに推奨される構成は、RoCE ネットワークを使用する GDPC です。

- すべてのメンバーおよび CF ホストから使用可能でなければなりません

- 既にホストから使用可能な他のネットワークとは異なる IP サブネットにする必要があります

TCP/IP ネットワーク上の GDPC (AIX および Linux)

- AIX での Infiniband (IB) ネットワーク上の GDPC のサポートは非推奨になり、将来のリリースで削除される予定です。 新しい GDPC インスタンスでは、代わりに RoCE または TCP/IP のネットワークを使用する必要があります。

- TCP/IP ネットワークを使用する GDPC の場合、アダプター・ポートはメンバー/CF ごとに複数個サポートされ、スイッチは 2 つの主要な実動サイトのサイトごとに 2 台サポートされます。 TCP/IP ネットワーク上の単一サイト Db2 pureScale の構成と同様に、CF およびメンバー通信用の複数の物理アダプター・ポートを結合して単一のインターフェースを形成する必要があります。

GDPC のワークロード分散

GDPC のワークロード分散は、単一サイトの Db2 pureScaleと同じように動作します。 Db2 pureScale クラスターに接続するクライアント・アプリケーションでは、通常、ワークロード・バランシング (WLB) が有効になっています。これにより、使用可能な容量が最も多いメンバーに作業が透過的にルーティングされます。 WLB によって、通常運用時にはリソースの最適な使用が維持され、また、メンバーのダウン時間 (計画されたものまたは計画外のもの) またはサイトの障害が発生した場合には、接続が転送されます。 しばしば多層環境のアプリケーション・サーバーとして構成されるクライアント・システムは、多くの場合サイト全体の冗長性を持たせて構成され、上層にもフォールト・トレランスを提供します。 特定のクライアント要求を物理的にいずれかのサイトに配置されているメンバーに経路指定する場合に、クライアント・アフィニティー・フィーチャーも GDPC で使用できます。